數字內容“遍地開花”,AI技術如何創新“造夢”?觀點

其中盤古媒體大模型在語音生成、視頻生成以及AI翻譯上的技術創新就重塑了數字內容生產和應用的新范式,AI技術賦能數字內容生產和應用,AI大模型在數字內容生產和應用上的問題主要呈現在三個層面。

文 | 智能相對論

作者 | 陳泊丞

這是春晚舞臺西安分會場《山河詩長安》的一幕:“李白”現世,帶領觀眾齊頌《將進酒》,將中國人骨子里的豪情與浪漫演繹得淋漓盡致。

這又是浙江義烏商品市場里的另一幕:只會說幾個英文單詞的女老板秒變外語達人,無縫切換36國語言流暢介紹自家商品,瘋狂帶貨。

這一幕幕不可思議的畫面,成就了今天中國文化、商業的頻頻出圈。而一切的背后,都有著相同的支持:AI技術賦能數字內容生產和應用。

近年來,隨著AI大模型技術的持續升級與賦能,數字內容生產與應用的趨勢愈發強烈,現實場景與數字內容不斷融合,悄然改變著整個內容創作行業的格局,甚至進一步推動了相關產業和商業的新變革。

技術創新重塑數字內容生產與應用新范式

數字人“李白”的精彩演繹、義烏女老板的AI帶貨——這些熱門事件的背后,是技術創新突破所帶來的結果。AI大模型的成熟應用,讓越來越多不同形式的數字內容得以爆發,并廣泛進入大眾視野。

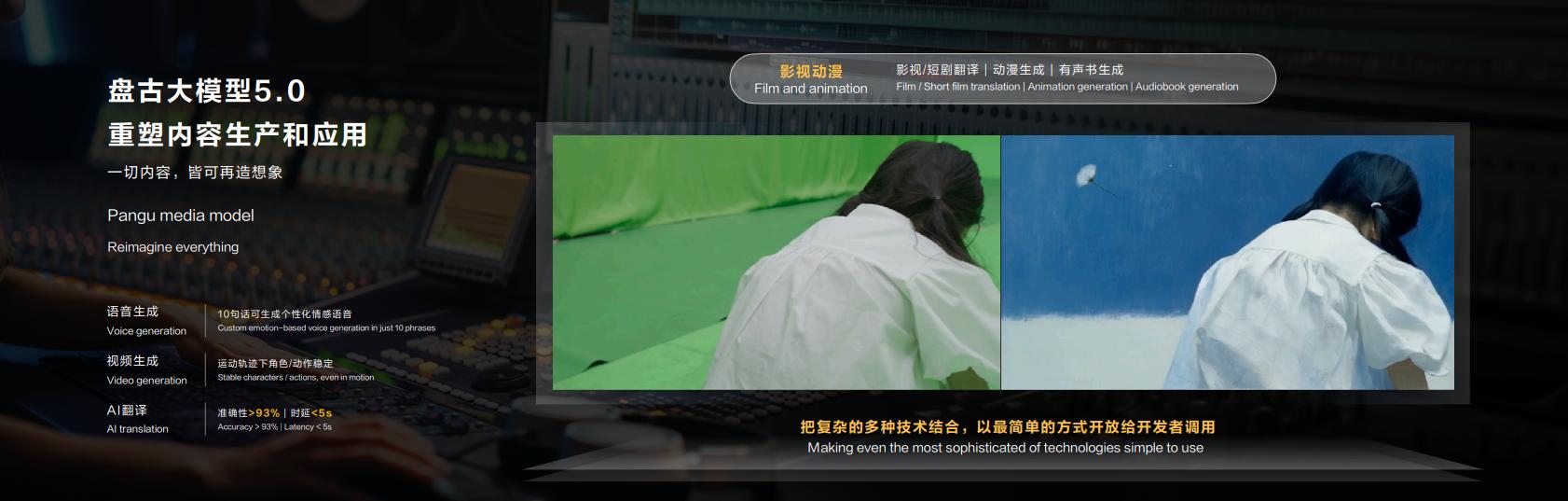

在6月21日舉辦的華為開發者大會(HDC 2024)上,華為云盤古大模型迎來5.0版本升級,其中盤古媒體大模型在語音生成、視頻生成以及AI翻譯上的技術創新就重塑了數字內容生產和應用的新范式。

對比過去的技術能力,新的技術所帶來的效果是非常顯著的。

一、語音生成進階:只需三言兩語,沉浸式、真實感的語音易如反掌

過去的語音生成依賴傳統的聲音克隆模型,由于模型比較小,精度低等原因,往往在實際操作上就要復雜得多。比如,在數據收集階段,對目標人物的語音數據就要盡可能的多樣化,包括不同的語速、語調、音量以及不同語境下的語音,需用到幾百句話的錄音。

然后到了預處理階段,需要對收集到的語音數據進行清洗,通過人工標注等形式去除噪聲、靜音片段和其他不需要的部分。進而還要進行語音分割,將連續的語音信號切割成較小的語音片段(如音素或單詞)。最后提取音頻特征,再用于后續的聲音建模。

以上,還只是數據收集和預處理,尚未進入真正的語音生成階段。但其中的工作量和操作復雜度就已經很大了,對語音生成的效率和質量都是一個非常大的影響和挑戰。

時至今日,隨著技術的創新,基于更先進的模型,比如盤古媒體大模型的語音生成能力,這一問題得到了很好的解決。只需要幾句話、幾秒鐘的聲音,AI即可學習到個性化的音色、語調、表達韻律,從而獲得高質量的個性化語音。同時,還支持喜怒哀樂等擬人情感語音,閑聊、新聞、直播等10多種語氣風格,讓生成的語音更真實、更有情感色彩,能沉浸式地應用到不同場景中。

比如,在視頻譯制中,AI將能做到配音演員的專業程度——通過盤古媒體大模型提供的視頻翻譯能力,AI可以把視頻翻譯為目標語言,并保留原始角色的音色、情感、語氣。華為云也在積極聯合伙伴邏輯智能,打造高感情語音克隆以及14國小語種配音,共同構建高感情超擬人多模態音頻應用能力等。同時,再結合盤古媒體大模型的口型驅動模型,還可以實現音唇同步,尤其是在側面、多人對話、物體遮擋以及人物移動等場景,也能做到很好的口型匹配。

二、視頻生成跨越:只需幾十張圖,可控的、一致的視頻唾手可得

傳統的視頻生成技術在資源需求、數據集、時序一致性、物理定律遵守、效率與質量平衡、可控性、逼真度和連貫性以及應用限制等方面都存在一定的局限性。如今,基于盤古媒體大模型,只需要訓練幾十張特定美學風格的圖片,如吉卜利、二次元等風格,再輸入實拍視頻即可快速生成該風格的動漫視頻。

除了按需時長生成穩定的動漫視頻,再通過ID一致性模型,還能對生成畫面中的關鍵角色進行一致性處理,確保視頻中角色樣貌特征在前一幀和后一幀中所呈現的效果始終一致,在側臉、運動軌跡下的視覺效果合理一致,由此增強AI視頻生成的可控性、一致性,讓視頻內容更合理、真實。

此外,業內對視頻生成的真實度、復雜度也在聚焦增強。比如,OpenAI的Sora正在試圖模擬復雜的攝像機運鏡,同時準確地保持角色和視覺風格一致,讓AI創作的數字內容更加趨于現實創作。英偉達更是發布了一系列技術套件如ACE(NVIDIA Avatar Cloud Engine)、NeMo?以及RTX?等,去增強數字內容的真實感,讓數字人物的互動、對話更加復雜、逼真。

三、AI翻譯強化:準確性>93%,實時的、跨語言溝通指日可待

過去的機器翻譯系統往往是基于統計模型或規則模型構建的,因此翻譯結果大多無法與原文一致,顯得生硬、不自然,并不具備應用到不同場景的條件。現如今,華為云通過AI實現多語種實時傳譯,準確性>93%,可應用于實時通話、云會議等需要實時翻譯場景。

同時,基于盤古媒體大模型的語音復刻、AI文字翻譯以及TTS技術,便可以實現語音的同聲傳譯,成功實現跨語言母語溝通體驗。甚至還可以結合數字人技術,讓數字人來模擬用戶說話,結合口型模型技術做到口型與聲音精準匹配,讓AI翻譯、數字人與語音生成高度結合用于線上開會、跨國貿易交流等場景中。

技術的“瓶頸”在收縮?

技術的創新和突破帶來了數字內容生產和應用的爆發,但另一方面隨著生產和應用的進程加速,相應的技術瓶頸也在出現,并不斷收縮、聚焦。目前,AI大模型在數字內容生產和應用上的問題主要呈現在三個層面。

其一,能源與計算效率瓶頸。當前,大模型訓練的算力當量還在進一步增大,從GPT-3到GPT-4算力當量增長了68倍。隨著訓練的token數、模型參數增加,大模型訓練所需的計算量也需要隨之增加。

更重要的是,其背后的成本投入是難以為繼的。根據計算,訓練一個5000億參數規模的Dense模型,基礎算力設施投入約10億美金,無故障運行21個月,電費約5.3億元——這遠遠超出了企業的承受范圍。

但是,如果想要規模化地生產高質量的數字內容,大模型的精進又是必要的路徑。在這個階段,業內開始尋求更高效、更優的算力解決方案。像華為云昇騰AI云服務就在致力于提供方便、好用的算力服務,在算力層面不斷革新計算能力和計算效率,提供從云化算力、模型開發、模型托管到生態的全棧服務。

其二,算法架構的優化挑戰。隨著大模型參數的增加,想要實現更好的計算結果和輸出更優的答案,那么其處理的時長就會不斷延長的。但是,這在實際應用中是一個困擾數字內容生產和應用的顯著問題,非常不利于數字內容的規模化、商業化發展。

由此,業內也開始在算法架構上進行優化,調整計算邏輯、處理方法來實現更優效果。其中,以稀疏激活機制為代表的MoE模型就是目前AI行業的一個焦點,類似于“術業有專攻”的理念,稀疏激活機制通過對數據任務進行拆解,分門別類,再分配給特定的“專家”(Experts)進行處理,最終綜合加權輸出——不僅實現了計算效率優化,也讓輸出結果更加全面、強大。

其三,安全與倫理問題。大模型內部運行機制復雜,生產出來的內容欠缺可解釋性和可控性,又易受對抗樣本攻擊,存在監管難題和安全漏洞。對此,在數字內容生產和應用中,相關的安全和倫理問題隨著行業的廣泛發展而日趨突顯。

因此,在數字內容行業高速發展的階段,盡管企業能吃上數字內容的紅利,但也需要鑒別模型的安全性、可靠性,避免因模型的安全和倫理問題而引發負面輿論影響。在這樣的挑戰下,華為云盤古大模型也隨即作出升級,在數據治理、安全合規等方面達到了較高標準。

以技術“造夢”,數字內容未來可期

新范式的明確帶來更明確的技術方向,對于整個數字內容行業而言,這意味著未來的發展已經有了基礎的雛形,前景仍是樂觀的。但是,不可忽視的是,技術的瓶頸客觀存在,且更加突出,擺在行業面前的依舊是一條較為嚴峻的發展之路。

盡管拋開技術瓶頸不談,在具體的實踐中,數字內容的生產和應用也不簡單,往往都需要面對很多在技術之外的具像化問題,只有基于問題去一步步解決才能最終完成落地。

華為云團隊在進行紀錄片譯制時就發現,項目實際開展起來會遇到各種各樣的問題,比如環境聲音太雜太亂,AI無法準確識別人聲保證音譯的完整度,或是隨著場景的切換,人物的狀態、口型都呈現出不同的樣子,需要AI精準地匹配等等。

如果這些問題不一一解決,AI譯制的效果就打了個大大的折扣。對此,華為云團隊通過精準分析問題,采用不同的技術去解決各類細微問題,比如通過分離模型技術讓環境聲和人聲分開,通過口型模型技術讓聲音與口型精準匹配等。

技術或許一直都有,但是如何用恰恰才是項目落地的關鍵。換句話說,在今天數字內容行業高速發展、技術創新加速迭代的階段,只有實踐了才能真正推動行業的發展。這是一個比拼項目的階段,誰家的項目經驗越豐富,越能知道相關的技術應該如何應用才能發揮出應有的效果。

目前,中影集團與華為云合作,將媒體大模型應用到影視工業,共同打造影視譯制大模型,通過AI將視頻譯制成不同語言,并保留原始角色的音色、情感、語氣,還能支持口型匹配,為影片譯制提供全新的AI制作方式。

今天,數字內容迎來迸發,越來越多精彩內容面世的另一面恰恰是廠商們不斷運用技術、驗證技術、完善技術的過程。未來的項目之路任重而道遠,同時也是行業走向成熟的必經之路。靜待技術在創新中、實踐中持續升級、完善,未來便更快能看到一個數字內容精彩紛呈,如同夢境一般的世界。

*本文圖片均來源于網絡

此內容為【智能相對論】原創,

僅代表個人觀點,未經授權,任何人不得以任何方式使用,包括轉載、摘編、復制或建立鏡像。

部分圖片來自網絡,且未核實版權歸屬,不作為商業用途,如有侵犯,請作者與我們聯系。

?AI產業新媒體;

?澎湃新聞科技榜單月度top5;

?文章長期“霸占”鈦媒體熱門文章排行榜TOP10;

?著有《人工智能 十萬個為什么》

?【重點關注領域】智能家電(含白電、黑電、智能手機、無人機等AIoT設備)、智能駕駛、AI+醫療、機器人、物聯網、AI+金融、AI+教育、AR/VR、云計算、開發者以及背后的芯片、算法等。

1.TMT觀察網遵循行業規范,任何轉載的稿件都會明確標注作者和來源;

2.TMT觀察網的原創文章,請轉載時務必注明文章作者和"來源:TMT觀察網",不尊重原創的行為TMT觀察網或將追究責任;

3.作者投稿可能會經TMT觀察網編輯修改或補充。